简单聊一下Android音频通路的切换

2017年02月05日 22:19:38 一直熊 阅读数:14217 标签: android 更多 个人分类: android Android支持多种设备的的输出。一台正常的机子,本身就自带话筒,扬声器,麦克风等多个声音输入输出设备,再加上五花八门的外置设备(通过耳机,蓝牙,wifi等方式连接),使声音的输出更具多样性。Android支持如此多的设备连接,那么android内部是怎样对设备的输出输出进行控制的呢?这一次我们主要来看看音频通路的切换。音频流、设备、音频策略

要想知道Andorid是怎样对设备的输出输出进行控制的,我们首先来了解一些音频相关的基本知识: stream_type、content_type、devices、routing_strategy。stream_type:音频流的类型。在当前系统中,Android(6.0)一共定义了11种stream_type以供开发者使用。Android上层开发要想要发出声音,都必须先确定当前当前的音频类型。

content_type:具体输出类型。虽然当前一共有11种stream_type,但一旦进入到Attribute,Android就只将其整理成几种类型。这才是实际的类型。

device:音频输入输出设备。Android定义了多种设备输入输出设备(具体物理设备可能还是那几个,但是输出场景不尽相同)。

routing_strategy:音频路由策略。默认情况下,Android是根据路由策略去选择设备负责输出输入音频的。 stream_type在android中java层与c++层均有定义。并且对应的值是保持一致的。

device与stream_type一样,在java层和C++层均有定义,并且会根据使用的情况不同蕴含多个定义:

device与stream_type一样,在java层和C++层均有定义,并且会根据使用的情况不同蕴含多个定义:

相对stream_type,routing_strategy只是一个定义在RountingStrategy.h的一个简单的枚举结构体:

相对stream_type,routing_strategy只是一个定义在RountingStrategy.h的一个简单的枚举结构体:

usecase只是qcom内部定义的一个数据结构,位于hal层,用作处理处理内部声卡逻辑和输出方案。输出方案与声卡中的mixer_path_xxx.xml相联。而mixer_path等相关文件,才是具体的音频输出方案。

usecase只是qcom内部定义的一个数据结构,位于hal层,用作处理处理内部声卡逻辑和输出方案。输出方案与声卡中的mixer_path_xxx.xml相联。而mixer_path等相关文件,才是具体的音频输出方案。

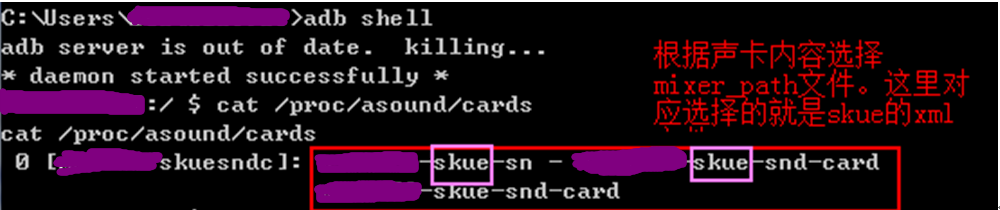

我们通过查看当前的声卡情况确定了当前具体的mixer_path文件——mixer_path_skue.xml。xml文件内部就是我们预定义的usecase的具体情况:

我们通过查看当前的声卡情况确定了当前具体的mixer_path文件——mixer_path_skue.xml。xml文件内部就是我们预定义的usecase的具体情况:

在mixer_path类文件中,一个标准的path就如上面的红框那样。有名字,有一定的参数。另外,一个patch之中,还可以嵌套另外一个patch。 由于usecase只是目前高通hal层独有的定义,所以本文不会花太多时间和精力去探讨usecase的相关设置和内容。目前来说,对这个有一定的认知就可。

AudioPolicy和AudioPolicyService

在了解完Audio一些基本的定义设定之后,我们来看一下Android的Audio整体架构。Audio内部系统从上到下包含各方面的东西。对于声音输出的设备的选择与切换,我们主要需要关注2个地方。第一处,是外接设备如耳机,蓝牙设备等连接的通知。第二处就是Audio系统中核心的AudioFinger与AudioPolicyService的处理内容。

AudioFinger是Audio系统的工作引擎,管理者系统中输入输出音频流,并承担音频数据混音,以及读写Audio硬件等工作以实现数据的输入输出功能。AudioPolicyService是Audio系统策略控制中心,具体负责掌管系统中声音设备的选择和切换,音量控制等功能。

AudioFinger与AudioPolicyService的类图关系:

在AudioFlinger和AudioPolicyService的运作中其实包含着很多类,但同时,我们也可以发现,在Audio系统中, AudioFinger与AudioPolicyService是紧密相连的。总得来说,AudioFinger与AudioPolicyService是Audio系统的核心。所以下面我们很多内容的主角,都是他们2个。

基本的声音输出调用

发出声音是Android机器的一个最基本的功能。但是,Android是怎么发出声音的呢?就算不连接外设,Android最基本还有听筒和扬声器2个设备。那么,Android内部,是怎么控制他们2个发出声音的呢?下面我们来具体看 一下Android一般情况下发出声音时选择设备的过程。

我们要想分析Android中的声音输出,当然是先通过播放音频去一步一步了解Android是怎恶魔输出声音的。下面我们以一个最简单的AudioTrack播放音频为例,来看下Android的发生过程。

一个简单的AudioTrack播放的例子如下:

-

AudioTrack audioTrack = new AudioTrack(AudioManager.STREAM_MUSIC, 11025/2, -

AudioFormat.CHANNEL_CONFIGURATION_MONO, -

AudioFormat.ENCODING_PCM_16BIT, -

audioLength, AudioTrack.MODE_STREAM); -

audioTrack.play(); -

audioTrack.write(audioData, 0, sizeInBytes);

AudioTrack在接收参数创建的时候,就会将设置的steamtype保存在对应的AudioAttributes当中(AudioAttributes是一个描述关于音频流的信息的属性集合的类)。

我们知道,在android系统中,系统封装的对象是一层一层往下调用的。所以,在我们创建了一个java的AudioTrack对象的时候,其实在同时,在C++当中,我们已经做了很多操作了。下面我们来看一下,AudioTrack对象创建时,主要做了什么:

-

static jint -

android_media_AudioTrack_setup(JNIEnv *env, jobject thiz, jobject weak_this, -

jobject jaa, -

jint sampleRateInHertz, jint channelPositionMask, jint channelIndexMask, -

jint audioFormat, jint buffSizeInBytes, jint memoryMode, jintArray jSession) { -

//…… -

// create the native AudioTrack object -

splpTrack = new AudioTrack(); -

//…… -

// initialize the native AudioTrack object -

status_t status = NO_ERROR; -

switch (memoryMode) { -

case MODE_STREAM: -

status = lpTrack->set( -

AUDIO_STREAM_DEFAULT, -

sampleRateInHertz, -

format, -

nativeChannelMask, -

frameCount, -

AUDIO_OUTPUT_FLAG_NONE, -

audioCallback, &(lpJniStorage->mCallbackData), -

0, -

0, -

true, -

sessionId, -

AudioTrack::TRANSFER_SYNC, -

NULL, -

-1, -1, -

paa); -

break; -

//…… -

if (status != NO_ERROR) { -

ALOGE("Error %d initializing AudioTrack", status); -

goto native_init_failure; -

} -

// save our newly created C++ AudioTrack in the "nativeTrackInJavaObj" field -

// of the Java object (in mNativeTrackInJavaObj) -

setAudioTrack(env, thiz, lpTrack); -

//…… -

}

-

AudioTrack::AudioTrack() -

: mStatus(NO_INIT), -

mIsTimed(false), -

mPreviousPriority(ANDROID_PRIORITY_NORMAL), -

mPreviousSchedulingGroup(SP_DEFAULT), -

mPausedPosition(0), -

mSelectedDeviceId(AUDIO_PORT_HANDLE_NONE), -

mPlaybackRateSet(false) -

{ -

mAttributes.content_type = AUDIO_CONTENT_TYPE_UNKNOWN; -

mAttributes.usage = AUDIO_USAGE_UNKNOWN; -

mAttributes.flags = 0x0; -

strcpy(mAttributes.tags, ""); -

}

-

status_t AudioTrack::set(…){ -

//…… -

status_t status = createTrack_l(); -

if (status != NO_ERROR) { -

if (mAudioTrackThread != 0) { -

mAudioTrackThread->requestExit(); // see comment in AudioTrack.h -

mAudioTrackThread->requestExitAndWait(); -

mAudioTrackThread.clear(); -

} -

return status; -

//…… -

}

-

status_t AudioTrack::createTrack_l() -

{ -

const sp& audioFlinger = AudioSystem::get_audio_flinger(); -

if (audioFlinger == 0) { -

ALOGE("Could not get audioflinger"); -

return NO_INIT; -

} -

audio_io_handle_t output; -

audio_stream_type_t streamType = mStreamType; -

audio_attributes_t *attr = (mStreamType == AUDIO_STREAM_DEFAULT) ? &mAttributes : NULL; -

//…… -

audio_offload_info_t tOffloadInfo = AUDIO_INFO_INITIALIZER; -

if (mPlaybackRateSet == true && mOffloadInfo == NULL && mFormat == AUDIO_FORMAT_PCM_16_BIT) { -

mOffloadInfo = &tOffloadInfo; -

} -

status_t status = AudioSystem::getOutputForAttr(attr, &output, -

(audio_session_t)mSessionId, &streamType, mClientUid, -

mSampleRate, mFormat, mChannelMask, -

mFlags, mSelectedDeviceId, mOffloadInfo); -

//…… -

IAudioFlinger::track_flags_t trackFlags = IAudioFlinger::TRACK_DEFAULT; -

//…… -

sptrack = audioFlinger->createTrack(streamType, -

mSampleRate, -

mFormat, -

mChannelMask, -

&temp, -

&trackFlags, -

mSharedBuffer, -

output, -

tid, -

&mSessionId, -

mClientUid, -

&status); -

//……

根据AudioTrack的性质,Java层在创建完成AudioTrack对象直接调用play()和write()操作,那么其实从另一方面我们可以猜想,在Java层创建完成AudioTrack之后,系统已经设置好输出的设备等等操作,只等调用play()和write方法进行播放。所以为了验证我们的猜想,接下来针对AudioFlinger&AudioSystem的相关具体分析验证。

根据AudioTrack的性质,Java层在创建完成AudioTrack对象直接调用play()和write()操作,那么其实从另一方面我们可以猜想,在Java层创建完成AudioTrack之后,系统已经设置好输出的设备等等操作,只等调用play()和write方法进行播放。所以为了验证我们的猜想,接下来针对AudioFlinger&AudioSystem的相关具体分析验证。

AudioFlinger&AudioPolicyService的控制过程

回到上面的内容,我们可以看到,AudioTrack在调用createTrack_l()的方法的时候,开始通过AudioSystem获取output。所以下面我们来看看AudioSystem的getOutputForAttr():-

status_t AudioSystem::getOutputForAttr() -

{ -

const sp& aps = AudioSystem::get_audio_policy_service(); -

if (aps == 0) return NO_INIT; -

return aps->getOutputForAttr(attr, output, session, stream, uid, -

samplingRate, format, channelMask, -

flags, selectedDeviceId, offloadInfo); -

}

-

status_t AudioPolicyManager::getOutputForAttr() -

{ -

//…… -

*stream = streamTypefromAttributesInt(&attributes); -

spdeviceDesc; -

for (size_t i = 0; i < mAvailableOutputDevices.size(); i++) { -

if (mAvailableOutputDevices[i]->getId() == selectedDeviceId) { -

deviceDesc = mAvailableOutputDevices[i]; -

break; -

} -

} -

mOutputRoutes.addRoute(session, *stream, SessionRoute::SOURCE_TYPE_NA, deviceDesc, uid); -

//根据strategy获取device -

routing_strategy strategy = (routing_strategy) getStrategyForAttr(&attributes); -

audio_devices_t device = getDeviceForStrategy(strategy, false /*fromCache*/); -

if ((attributes.flags & AUDIO_FLAG_HW_AV_SYNC) != 0) { -

flags = (audio_output_flags_t)(flags | AUDIO_OUTPUT_FLAG_HW_AV_SYNC); -

} -

*output = getOutputForDevice(device, session, *stream, -

samplingRate, format, channelMask, -

flags, offloadInfo); -

//……

从audio_attributes_t的结构我们可以看出,audio_attributes_t保存着需要输出音频的应用的相关配置信息。

然后,根据刚刚的代码,我们来了解一下strategy的获取:

从audio_attributes_t的结构我们可以看出,audio_attributes_t保存着需要输出音频的应用的相关配置信息。

然后,根据刚刚的代码,我们来了解一下strategy的获取:

-

uint32_t AudioPolicyManager::getStrategyForAttr(const audio_attributes_t *attr) { -

// flags to strategy mapping -

if ((attr->flags & AUDIO_FLAG_BEACON) == AUDIO_FLAG_BEACON) { -

return (uint32_t) STRATEGY_TRANSMITTED_THROUGH_SPEAKER; -

} -

if ((attr->flags & AUDIO_FLAG_AUDIBILITY_ENFORCED) == AUDIO_FLAG_AUDIBILITY_ENFORCED) { -

return (uint32_t) STRATEGY_ENFORCED_AUDIBLE; -

} -

// usage to strategy mapping -

return static_cast(mEngine->getStrategyForUsage(attr->usage));

-

audio_devices_t AudioPolicyManager::getDeviceForStrategy(routing_strategy strategy, -

bool fromCache) -

{ -

// Routing -

// see if we have an explicit route -

// scan the whole RouteMap, for each entry, convert the stream type to a strategy -

// (getStrategy(stream)). -

// if the strategy from the stream type in the RouteMap is the same as the argument above, -

// and activity count is non-zero -

// the device = the device from the descriptor in the RouteMap, and exit. -

for (size_t routeIndex = 0; routeIndex < mOutputRoutes.size(); routeIndex++) { -

sproute = mOutputRoutes.valueAt(routeIndex); -

routing_strategy strat = getStrategy(route->mStreamType); -

bool strategyMatch = (strat == strategy) || -

((strategy == STRATEGY_ACCESSIBILITY) && -

((mEngine->getStrategyForUsage( -

AUDIO_USAGE_ASSISTANCE_ACCESSIBILITY) == strat) || -

(strat == STRATEGY_MEDIA))); -

if (strategyMatch && route->isActive()) { -

return route->mDeviceDescriptor->type(); -

} -

} -

if (fromCache) { -

ALOGVV("getDeviceForStrategy() from cache strategy %d, device %x", -

strategy, mDeviceForStrategy[strategy]); -

return mDeviceForStrategy[strategy]; -

} -

return mEngine->getDeviceForStrategy(strategy); -

}

-

audio_devices_t Engine::getDeviceForStrategy(routing_strategy strategy) const -

{ -

const DeviceVector &availableOutputDevices = mApmObserver->getAvailableOutputDevices(); -

const DeviceVector &availableInputDevices = mApmObserver->getAvailableInputDevices(); -

const SwAudioOutputCollection &outputs = mApmObserver->getOutputs(); -

uint32_t device = AUDIO_DEVICE_NONE; -

uint32_t availableOutputDevicesType = availableOutputDevices.types(); -

switch (strategy) { -

//…… -

case STRATEGY_MEDIA: { -

uint32_t device2 = AUDIO_DEVICE_NONE; -

if (isInCall() && (device == AUDIO_DEVICE_NONE)) { -

// when in call, get the device for Phone strategy -

device = getDeviceForStrategy(STRATEGY_PHONE); -

break; -

} -

if (strategy != STRATEGY_SONIFICATION) { -

// no sonification on remote submix (e.g. WFD) -

if (availableOutputDevices.getDevice(AUDIO_DEVICE_OUT_REMOTE_SUBMIX, String8("0")) != 0) { -

device2 = availableOutputDevices.types() & AUDIO_DEVICE_OUT_REMOTE_SUBMIX; -

} -

} -

if (isInCall() && (strategy == STRATEGY_MEDIA)) { -

device = getDeviceForStrategy(STRATEGY_PHONE); -

break; -

} -

if ((device2 == AUDIO_DEVICE_NONE) && -

(mForceUse[AUDIO_POLICY_FORCE_FOR_MEDIA] != AUDIO_POLICY_FORCE_NO_BT_A2DP) && -

(outputs.getA2dpOutput() != 0)) { -

device2 = availableOutputDevicesType & AUDIO_DEVICE_OUT_BLUETOOTH_A2DP; -

if (device2 == AUDIO_DEVICE_NONE) { -

device2 = availableOutputDevicesType & AUDIO_DEVICE_OUT_BLUETOOTH_A2DP_HEADPHONES; -

} -

//…… -

ALOGVV("getDeviceForStrategy() strategy %d, device %x", strategy, device); -

return device; -

}

针对音频通路的切换,我们就简单聊到这里。谢谢。

针对音频通路的切换,我们就简单聊到这里。谢谢。